- Введение в тему цензуры контента, созданного искусственным интеллектом

- Что представляет собой цензура в контексте ИИ?

- Формы цензуры ИИ-контента

- Аргументы за необходимость цензуры

- 1. Борьба с дезинформацией и фейковыми новостями

- 2. Предотвращение распространения вредоносного контента

- 3. Защита авторских прав и интеллектуальной собственности

- Аргументы против цензуры

- 1. Риск ограничения свободы слова и творчества

- 2. Сложности с объективностью и прозрачностью

- 3. Технические и экономические трудности

- Примеры и статистика

- Рекомендации и мнение автора

- Заключение

Введение в тему цензуры контента, созданного искусственным интеллектом

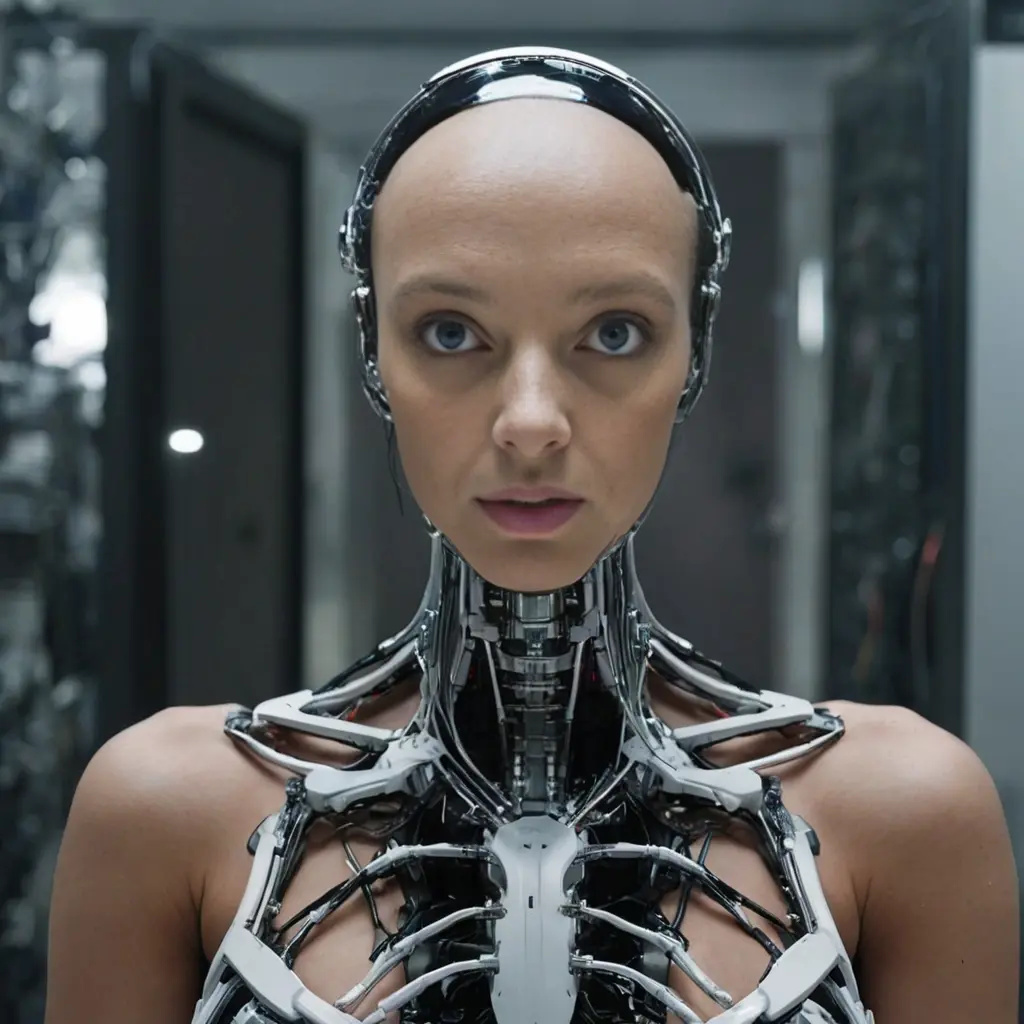

Сегодня искусственный интеллект становится неотъемлемой частью нашей жизни. Алгоритмы генерируют новости, создают художественные произведения, мультимедийный контент и даже ведут диалоги с пользователями. Однако способность ИИ создавать материалы, которые могут оказывать влияние на общественное мнение, формировать восприятие или даже распространять дезинформацию, ставит перед обществом новые этические и юридические вопросы.

Одним из ключевых становится вопрос цензуры — должна ли делаться фильтрация или ограничение контента, созданного искусственным интеллектом? Этот вопрос вызывает острые дискуссии среди юристов, разработчиков, экспертов по этике и простых пользователей.

Что представляет собой цензура в контексте ИИ?

Цензура — это контроль или ограничение доступа к информации, который может быть осуществлён государством, организациями или владельцами платформ. В цифровом пространстве цензура становится сложным явлением из-за быстрого распространения и огромного объёма контента.

Когда речь идёт именно про контент, созданный искусственным интеллектом, цензура приобретает новые оттенки, так как в некоторых случаях ИИ сам выступает генератором контента, а не только средством его распространения.

Формы цензуры ИИ-контента

- Автоматическая фильтрация: Когда системы ИИ анализируют создаваемый ими же или другими ИИ контент и блокируют нежелательные материалы.

- Модерация пользователями: Сообщества или платформы контролируют ИИ-контент, основываясь на жалобах или правилах.

- Правовые ограничения: Государственные законы, регулирующие тематику и тип контента от ИИ, включая запреты на определённые темы.

Аргументы за необходимость цензуры

1. Борьба с дезинформацией и фейковыми новостями

Искусственный интеллект способен создавать тексты и изображения, напоминающие реальные новости. По данным исследований, до 70% фейковых новостей может распространяться именно через алгоритмы и ботов, а не вручную. Это ставит под угрозу доверие общества к СМИ и демократическим институтам.

2. Предотвращение распространения вредоносного контента

ИИ может генерировать материалы, содержащие насилие, ненавистнические высказывания, пропаганду экстремизма или порнографию. Без контроля такие материалы могут негативно влиять на аудиторию, особенно на детей и подростков.

3. Защита авторских прав и интеллектуальной собственности

Автоматически созданный ИИ контент может нарушать права создателей оригинальных работ, копируя или сильно заимствуя чужие идеи. Цензура и фильтры помогают минимизировать эти правовые конфликты.

Аргументы против цензуры

1. Риск ограничения свободы слова и творчества

Жёсткая цензура может ограничить инновации и свободу самовыражения. Многие формы искусства и креативные эксперименты развиваются благодаря свободному обмену идеями, даже если они спорны или провокационны.

2. Сложности с объективностью и прозрачностью

Кто и как определяет, что считать нежелательным контентом? Автоматические алгоритмы могут допускать ошибки, а человеческая модерация подвержена субъективизму и политическому давлению.

3. Технические и экономические трудности

Обработка огромных объёмов информации требует значительных ресурсов, что усложняет создание эффективных систем фильтрации. К тому же могут пострадать малые компании и независимые разработчики ИИ, не способные обеспечить дорогостоящий контроль.

Примеры и статистика

| Сфера | Воздействие ИИ-контента | Необходимость цензуры |

|---|---|---|

| Новости и СМИ | Распространение фейковых новостей и пропаганды | Высокая — для предотвращения манипуляций общественным мнением |

| Развлечения (видео, игры) | Появление насильственного или порнографического контента | Средняя — важен баланс между свободой творчества и защитой аудитории |

| Образовательные материалы | Риск неточностей и искажений фактов | Высокая — необходима проверка точности и этичности |

| Социальные сети | Мемы, посты, комментарии от ИИ-ботов | Средняя — зависит от политики платформ |

Рекомендации и мнение автора

Искусственный интеллект — мощный инструмент, способный создавать невероятно разнообразный и полезный контент. Однако как и в случае с любыми технологиями, необходим баланс между свободой и ответственностью.

«Цензура контента, созданного ИИ, необходима, но она должна быть прозрачной, справедливой и подкреплённой этическими нормами. Автоматические системы фильтрации следует дополнять человеческим контролем, а пользователи — информировать о критериях отбора и причин блокировок. Только так можно сохранить свободу творчества и одновременно защитить общество от вредоносных проявлений.»

Также рекомендуется развивать международное сотрудничество, чтобы создать единые стандарты регулирования и избежать фрагментации правил, особенно в интернете, где границы практически отсутствуют.

Заключение

Вопрос цензуры контента, создаваемого искусственным интеллектом, далеко не однозначен. С одной стороны, без контроля ИИ может создавать и распространять опасные или ошибочные материалы, влияя на общество негативным образом. С другой — излишняя цензура способна подавить инновации, творчество и свободу слова.

Балансировка между этими полюсами требует взвешенного подхода, учитывающего технологические возможности и человеческие ценности. В конечном итоге, именно ответственное отношение к развитию и внедрению искусственного интеллекта станет залогом разумного и безопасного будущего цифрового контента.